本文转载自微信公众号「活在信息时代」,作者活在信息时代。转载本文请联系活在信息时代公众号。

循环神经网络(Recurrent Neural Network,RNN)主要是用来解决序列数据问题。它之所以成为循环神经网络,是因为一个序列的当前输出与前面的输出也是有关的。RNN网络对之前时刻的信息进行记忆,并运用到当前输出计算中,与卷积神经网络不同,循环神经网络隐藏层之间的神经元是相互连接的,隐藏层中神经元的输入是由输入层的输出和上一时刻隐藏神经元的输出共同构成。虽然RNN网络取得了一些显著成果,但是有一些缺点和局限,如:训练难度大、准确度低、效率低、时间长等,故基于RNN之上的一些改进的网络模型逐渐被研发出来,如:长短时记忆网络(Long Short-Term Memory,LSTM),双向RNN,双向LSTM、GRU等。这些改进的RNN模型在图像识别领域表现出了显出的效果,并被广泛应用。以LSTM网络为例,介绍下其主要网络结构。

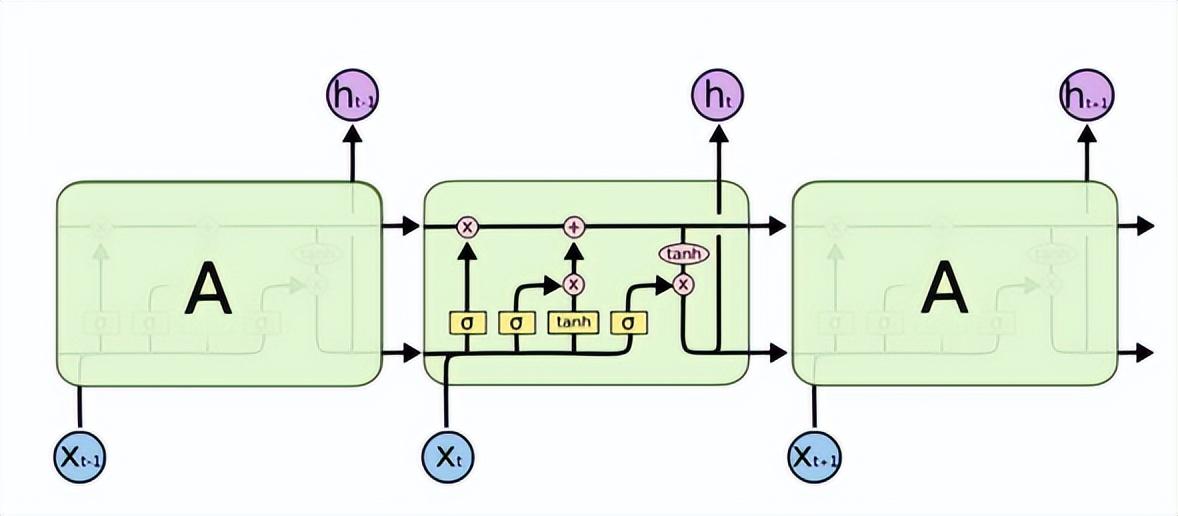

长短时记忆网络(Long Short-Term Memory,LSTM)解决了RNN存在着梯度消失或梯度爆炸等问题,可以学习长期依赖问题。其结构如下。

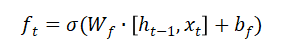

LSTM拥有三个门来让信息选择式通过:遗忘门、输入门、输出门。其中遗忘门决定着哪些信息可以通过这个cell。它通过一个sigmoid神经层来实现。它的输入是,输出是一个数值在(0,1)之间的向量,表示着让的各部分信息通过的比重。0表示“不让任何信息通过”,1表示“让所有信息通过”。

输入门决定着让多少新的信息加入到cell状态中来,一个tanh层生成一个向量,也就是备选的用来更新的内容。

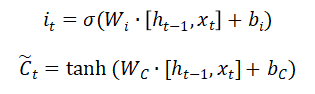

更新cell状态:

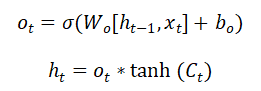

输出门决定中的哪部分信息被输出:

GRU网络模型也同样解决了RNN存在着梯度消失或梯度爆炸等问题,能够学习长期依赖关系,是LSTM的一种变形,结构比LSTM简单,具有更少的参数,训练时间也较LSTM有所缩短。也广泛应用于语音识别、图像描述、自然语言处理等场景。