Meta推出MoDem世界模型:解决视觉领域三大挑战,LeCun转发

12月27日,MetaAI 负责视觉和强化学习领域的A

截止27日晚间,这篇推文的阅读量已经达到73.9k。

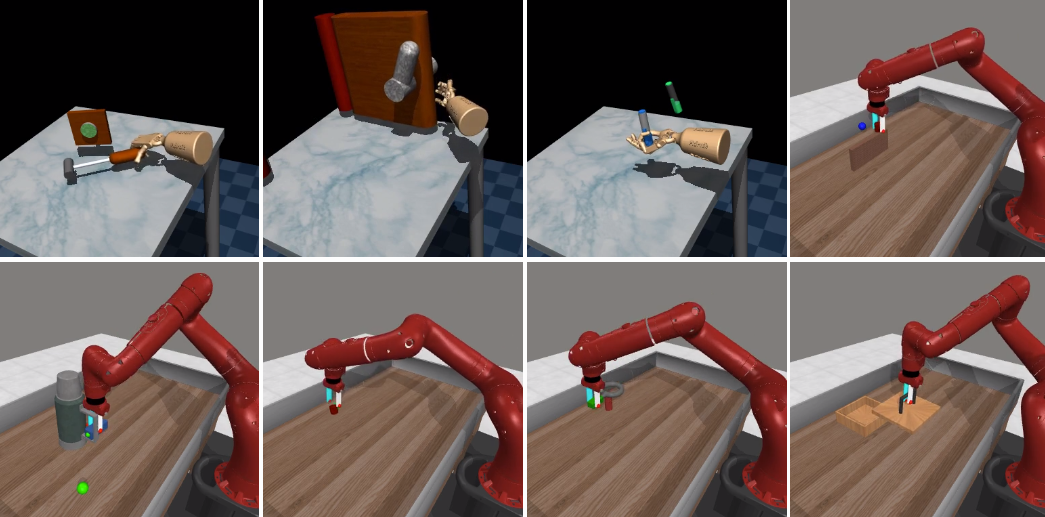

他表示,仅给出5个演示,MoDem就能在100K交互步骤中解决具有稀疏奖励和高维动作空间的具有挑战性的视觉运动控制任务,大大优于现有的最先进方法。

有多优秀呢?

他们发现MoDem在完成稀疏奖励任务方面的成功率比低数据机制中的先前方法高出150%-250%。

Lecun也转发了这一研究,表示MoDem的模型架构类似于JEPA,可在表征空间做出预测且无需解码器。

链接小编就放在下面啦,有兴趣的小伙伴可以看看~

论文链接:https://arxiv.org/abs/2212.05698

Github链接:https://github.com/facebookresearch/modem

研究创新和模型架构

样本效率低下是实际应用部署深度强化学习 (RL) 算法的主要挑战,尤其是视觉运动控制。

基于模型的RL有可能通过同时学习世界模型并使用合成部署来进行规划和政策改进,从而实现高样本效率。

然而在实践中,基于模型的RL的样本高效学习受到探索挑战的瓶颈,这次研究恰恰解决了这些主要挑战。

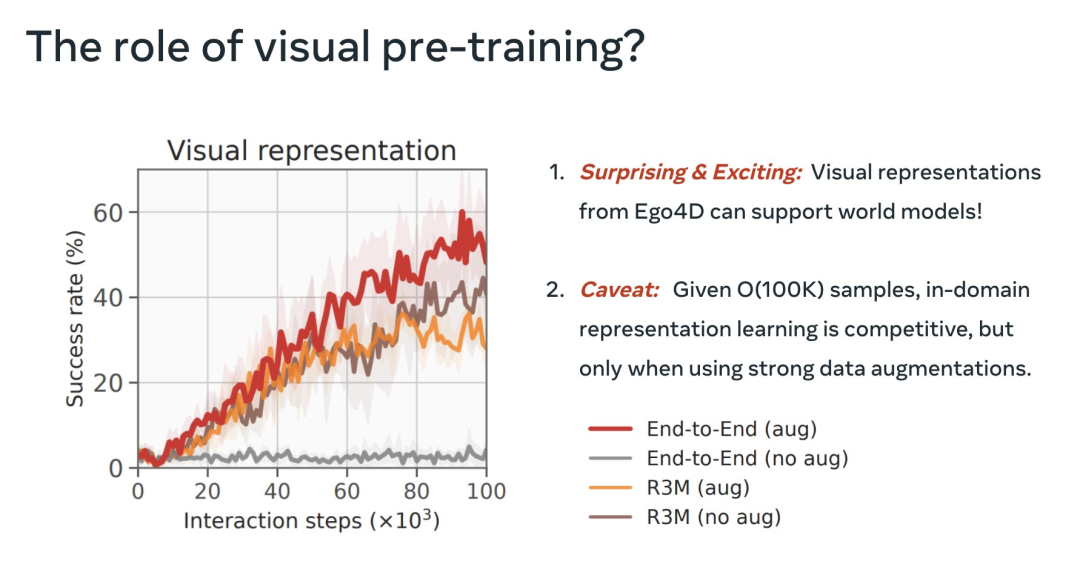

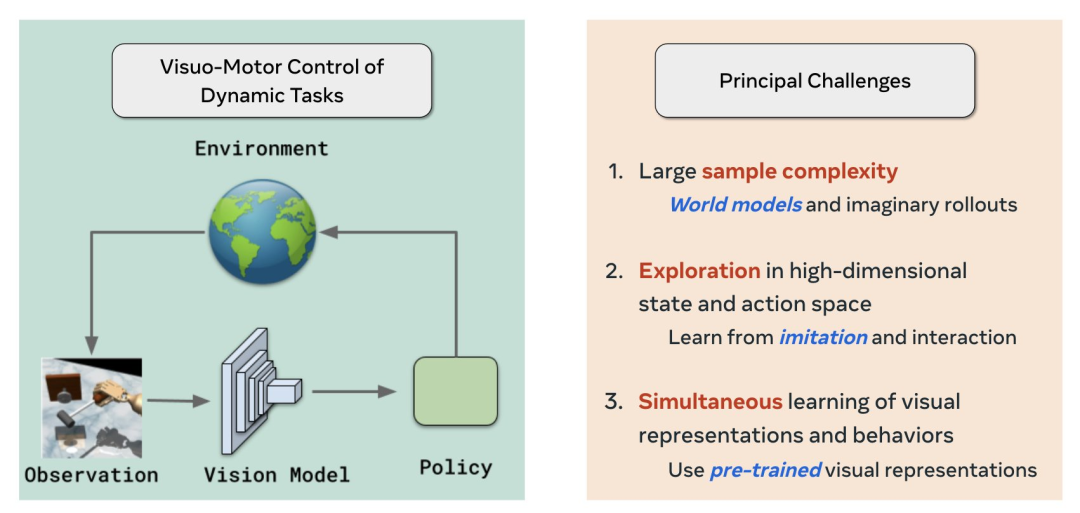

首先,MoDem分别通过使用世界模型、模仿+RL和自监督视觉预训练,解决了视觉强化学习/控制领域的三个主要挑战:

- 大样本复杂性(Large sample complexity)

- 高维状态和动作空间探索(Exploration in high-dimensional state and action space)

- 同步视觉表征和行为学习(Simultaneous learning of visual representations and behaviors)

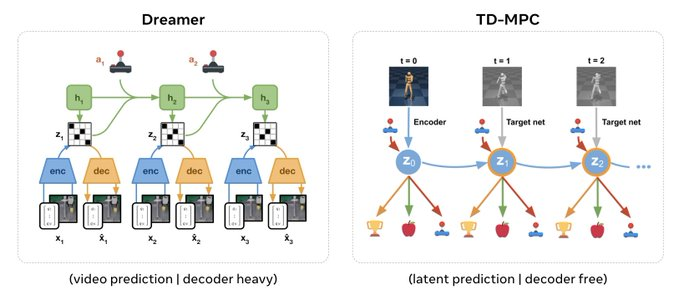

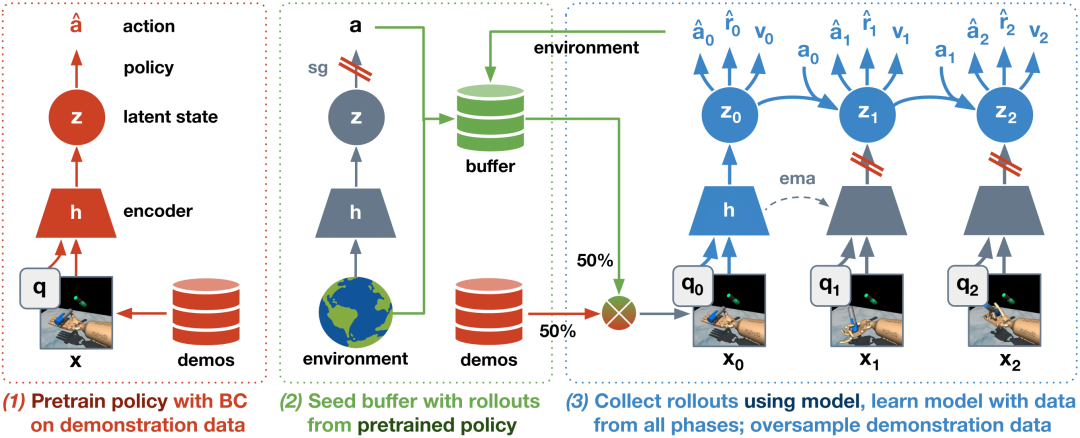

这次的模型架构类似于Yann LeCun的JEPA,并且无需解码器。

作者Aravind Rajeswaran表示,相比Dreamer需要像素级预测的解码器,架构繁重,无解码器架构可支持直接插入使用SSL预训练的视觉表示。

此外基于IL+RL,他们提出了一个三阶段算法:

- BC预训练策略

- 使用包含演示和探索的种子数据集预训练世界模型,此阶段对于整体稳定性和效率很重要

- 通过在线互动微调世界模型

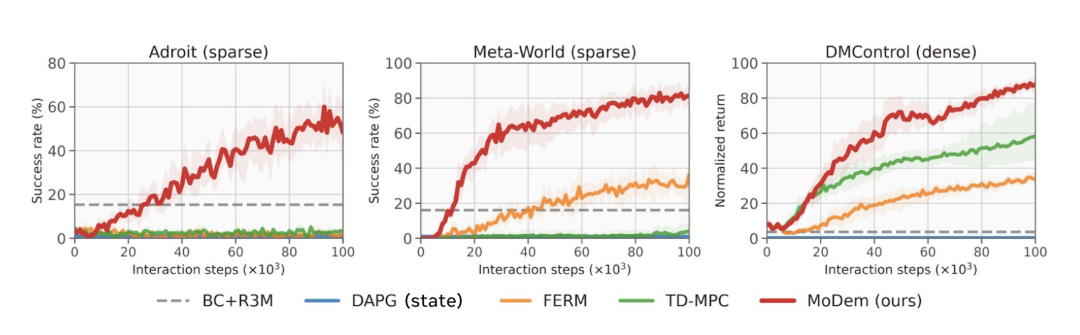

结果显示,生成的算法在21个硬视觉运动控制任务中取得了SOTA结果(State-Of-The-Art result),包括Adroit灵巧操作、MetaWorld和DeepMind控制套件。

从数据上来看,MoDem在各项任务中的表现远远优于其他模型,结果比之前的SOTA方法提升了150%到250%。

红色线条为MoDem在各项任务中的表现

在此过程中,他们还阐明了MoDem中不同阶段的重要性、数据增强对视觉MBRL的重要性以及预训练视觉表示的实用性。

最后,使用冻结的 R3M 功能远远优于直接的 E2E 方法。这很令人兴奋,表明视频中的视觉预训练可以支持世界模型。

但8月数据强劲的E2E与冻结的R3M竞争,我们可以通过预训练做得更好。