连百年梗图都整明白了!微软多模态「宇宙」搞定IQ测试,仅16亿参数

大模型的卷,已经不睡觉都赶不上进度了……

这不,微软亚研院刚刚发布了一个多模态大型语言模型(MLLM)—— KOSMOS-1。

论文地址:https://arxiv.org/pdf/2302.14045.pdf

论文题目Language Is Not All You Need,还得源于一句名言。

文中有这么一句话,「我语言的局限,就是我世界的局限。——奥地利哲学家Ludwig Wittgenstein」

那么问题来了……

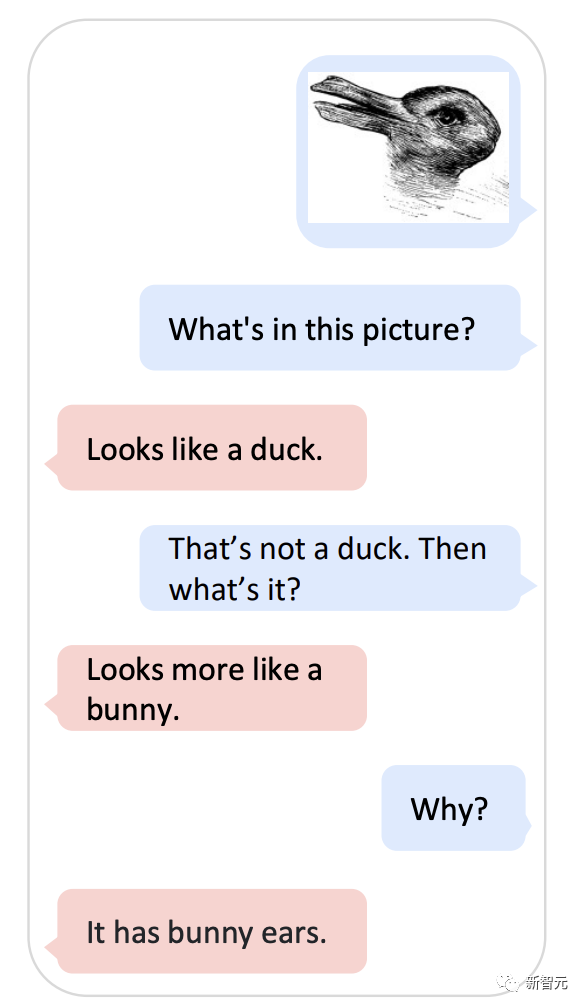

拿着图问KOSMOS-1「是鸭还是兔」能搞明白吗?这张有100多年历史的梗图硬是把谷歌AI整不会了。

1899年,美国心理学家Joseph Jastrow首次使用「鸭兔图」来表明感知不仅是人们所看到的,而且是一种心理活动。

现在,KOSMOS-1便能将这种感知和语言模型相结合。

-图中是什么?

-像一只鸭子。

-如果不是鸭子,那是什么?

-看起来更像兔子。

-为什么?

-它有兔子的耳朵。

这么一问,KOSMOS-1真有点像微软版的ChatGPT了。

不仅如此,Kosmos-1还能理解图像、文本、带有文本的图像、OCR、图像说明、视觉QA。

甚至IQ测试也不在话下。

「宇宙」无所不能

Kosmos来源希腊一词cosmos,有「宇宙」之意。

据论文介绍,最新Kosmos-1模型是一个多模态大型语言模型。

其主干是一个基于Transformer的因果语言模型,除了文本之外,其他模态,如视觉、音频都可以嵌入模型。

Transformer解码器用作多模态输入的通用接口,因此它能感知一般模态,进行上下文学习,并遵循指令。

Kosmos-1在语言和多模态任务上取得了令人印象深刻的表现,无需进行微调,其中包括带有文字指示的图像识别、视觉问答和多模态对话。

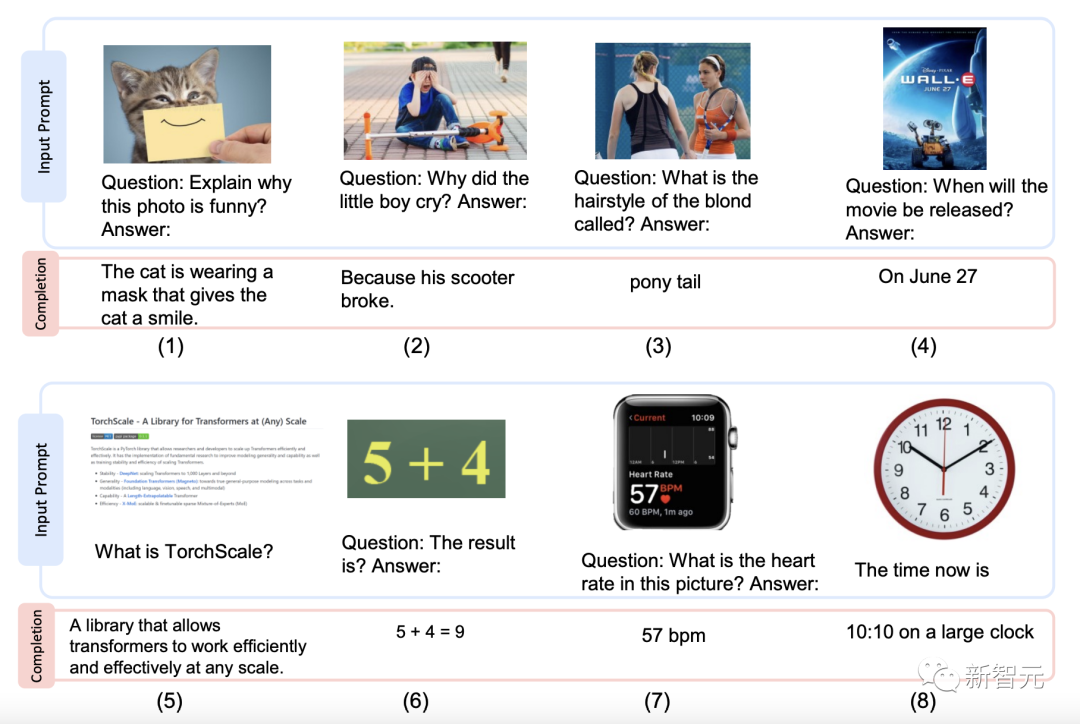

如下是Kosmos-1生成一些例子式样。

图片解释、图片问答、网页问题回答,简单数字公式,以及数字识别。

那么,Kosmos-1是在哪些数据集上进行预训练的呢?

训练所用的数据库,包括文本语料库、图像-字幕对、图像和文本交叉数据集。

文本语料库取自The Pile和Common Crawl(CC);

图像-字幕对的来源为English LAION-2B、LAION-400M、COYO-700M和Conceptual Captions;

文本交叉数据集的来源是Common Crawl snapshot。

数据库有了,接下来就是对模型进行预训练了。

MLLM组件有24层、2,048个隐藏维度、8,192个FFN和32个注意力头头,产生了大约1.3B的参数。

为了保证优化的稳定性,采用Magneto初始化;为了更快地收敛,图像表示是从一个预先训练好的具有1024个特征维度的CLIP ViT-L/14模型获取的。在训练过程中,图像被预处理成224×224分辨率,CLIP模型的参数除了最后一层均被冻结。

KOSMOS-1的参数总量约为16亿。

为了使KOSMOS-1更好地与指令保持一致,对其进行了只用语言的指令调整 [LHV+23, HSLS22],即用指令数据继续训练模型,该指令数据是仅有的语言数据,与训练语料库混合。

该调优过程是按照语言建模的方式进行的,选取的指令数据集为Unnatural Instructions [HSLS22]和FLANv2 [LHV+23]。

结果显示,指令跟随能力的提高可以跨模式转移。

总之,MLLM可以从跨模态迁移中获益,将知识从语言迁移到多模态,反之亦然;

5大类10个任务,都拿捏了

一个模型好不好使,拿出来溜溜就知道了。

研究团队从多角度进行实验来评价KOSMOS-1的性能,包括5大类十项任务:

1 语言任务(语言理解、语言生成、无OCR的文本分类)

2 多模态转移(常识推理)

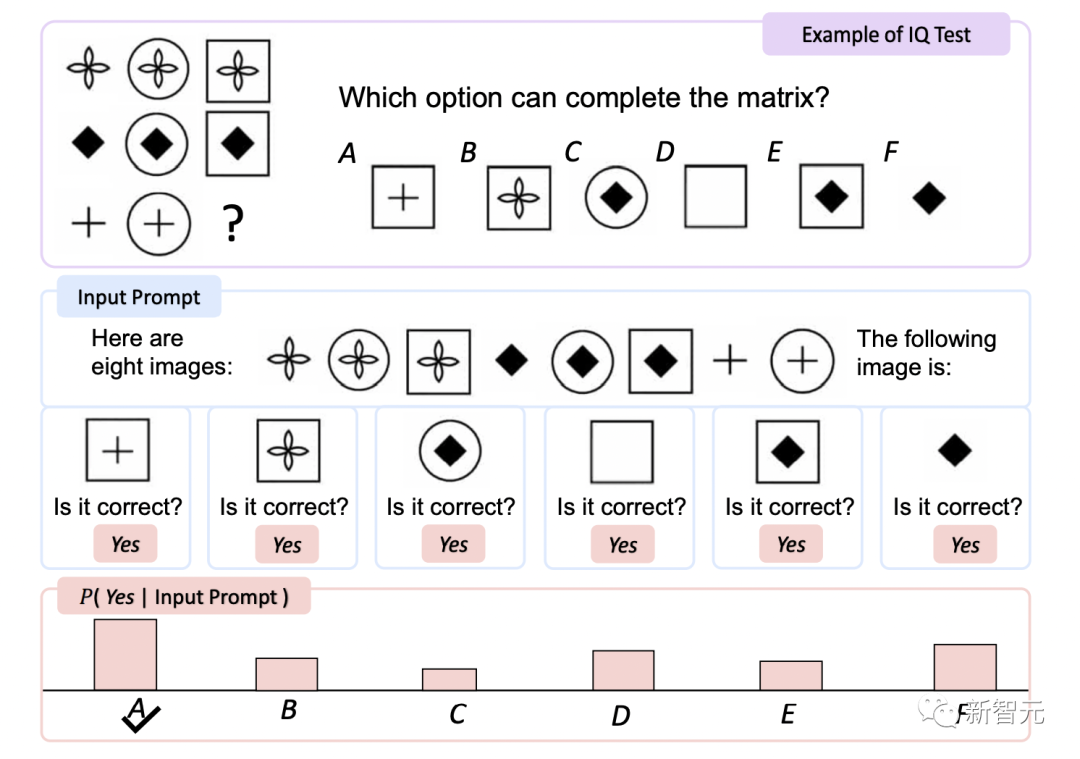

3 非语言推理(IQ测试)

4 感知-语言任务(图像说明、视觉问答、网页问答)

5 视觉任务(零样本图像分类、带描述的零样本图像分类)

无OCR的文本分类

这是一种不依赖于光学字符识别(OCR)的专注于文本和图像的理解任务。

KOSMOS-1对HatefulMemes和对Rendered SST-2测试集的准确率均高于优于其他模型。

而且Flamingo明确提供OCR文本到提示中,KOSMOS-1并没有访问任何外部工具或资源,这展示了KOSMOS-1阅读和理解渲染的图像中的文本的内在能力。

IQ测试

瑞文智力测试是评估非语言的最常用测试之一。

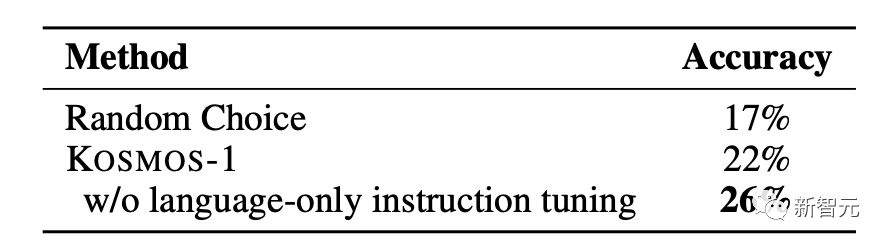

KOSMOS-1在没有进行微调时准确率比随机选择提高了5.3%,经过微调后则提高了9.3%,表明其具有感知非语言环境中的抽象概念模式的能力。

这是首次有模型能够完成零样本Raven测试,证明了MLLMs通过将感知与语言模型结合起来进行零样本非言语推理的潜力。

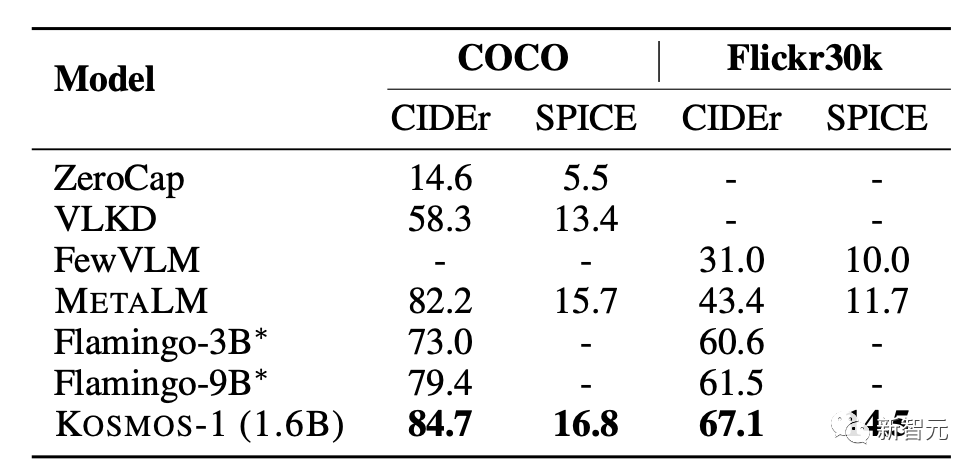

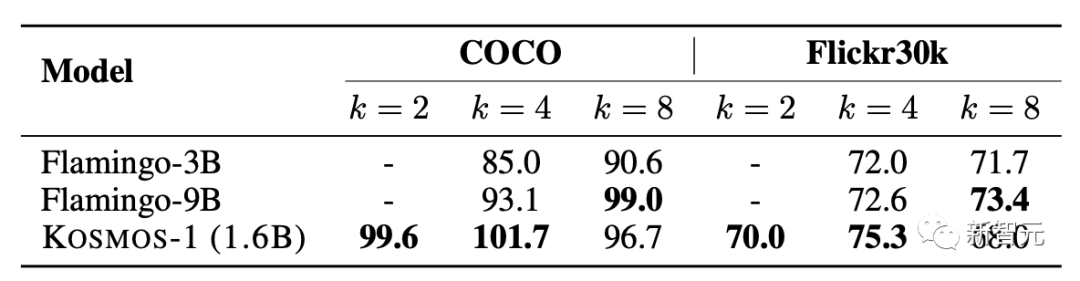

图像说明

KOSMOS-1在COCO和Flickr30k测试中的零样本性能均表现优秀,相比其他模型,其得分更高,但采用的参数量更小。

在少样本性能测试中,得分随着k值增大有所增加。

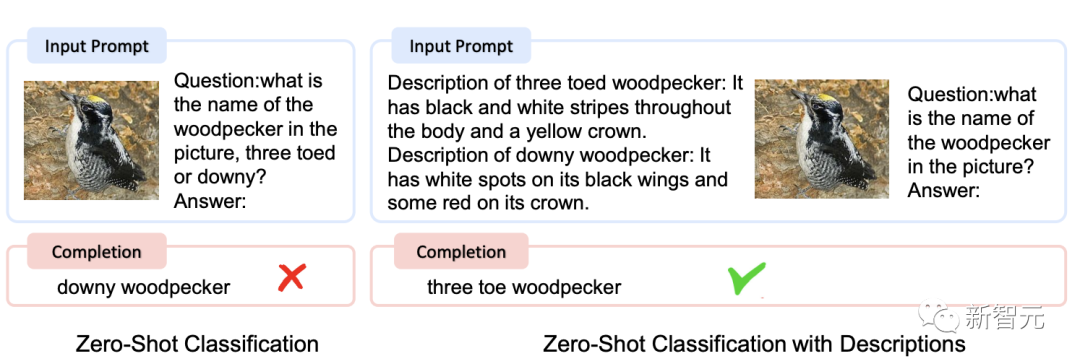

零样本图像分类

给定一个输入图像,并将该图像与提示 「The photo of the」连接起来。然后,输入模型以获得图像的类别名称。

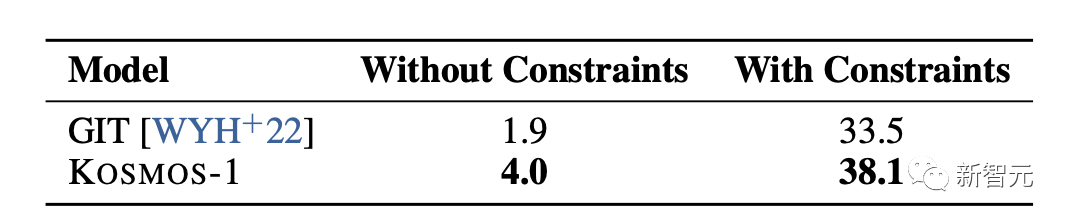

通过在ImageNet[DDS+09]上评估该模型,在有约束和无约束的条件下,KOSMOS-1的图像归类效果都明显优于GIT[WYH+22],展现了完成视觉任务的强大能力。

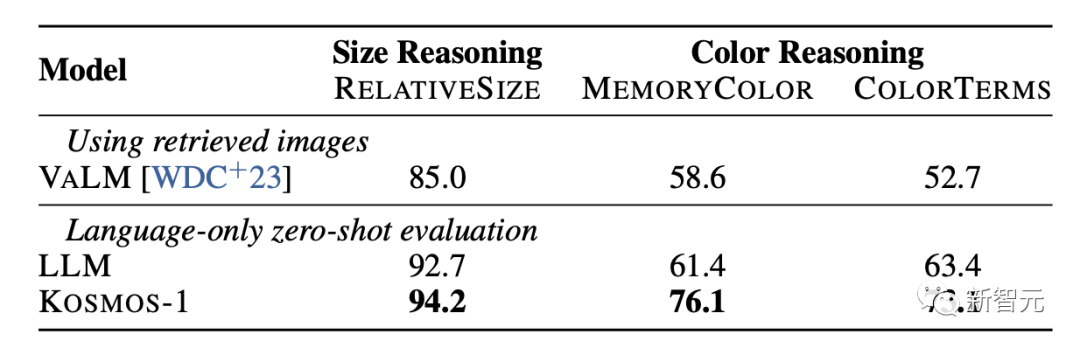

常识推理

视觉常识推理任务要求模型理解现实世界中日常物体的属性,如颜色、大小和形状,这些任务是具有挑战性的,因为它们可能需要比文本中更多的关于物体属性的信息。

结果显示,KOSMOS-1在尺寸和颜色方面的推理能力都明显好于LLM模型。这主要是因为KOSMOS-1具备多模态迁移能力,从而能够将视觉知识运用到语言任务中,而不必像LLM那样必须依靠文本知识和线索来推理。

对于微软Kosmos-1,网友称赞道,未来5年,我可以看到一个高级机器人浏览网络,并仅通过视觉方式基于人类的文本输入来工作。真是有趣的时代。