DPU 发展有望进入快车道。DPU(数据处理芯片 Data Process Unit)被认为是继 CPU 和 GPU 之后的“第三颗主力芯片”。得益于智能网卡方案的逐步成熟,叠加全球通用服务器出货量的稳定增长、L3 以上级别智能驾驶汽车的技术落地、工业控制领域的需求增加等原因,全球、国内 DPU 产业都有望实现快速发展。

全球 DPU 市场高景气延续,国内 DPU 市场加速追赶。据赛迪顾问《中国DPU行业发展白皮书》,2020 年全球 DPU 产业市场规模达 30.5 亿美元,预计到 2025 年全球 DPU 产业市场规模将超过 245.3 亿美元,复合增速达 51.73%。

2020 年中国 DPU 产业市场规模达 3.9 亿元,预计到 2025 年中国 DPU 产业市场规模将超过 565.9 亿元,复合增速达 170.6%。

DPU 产业链分析:

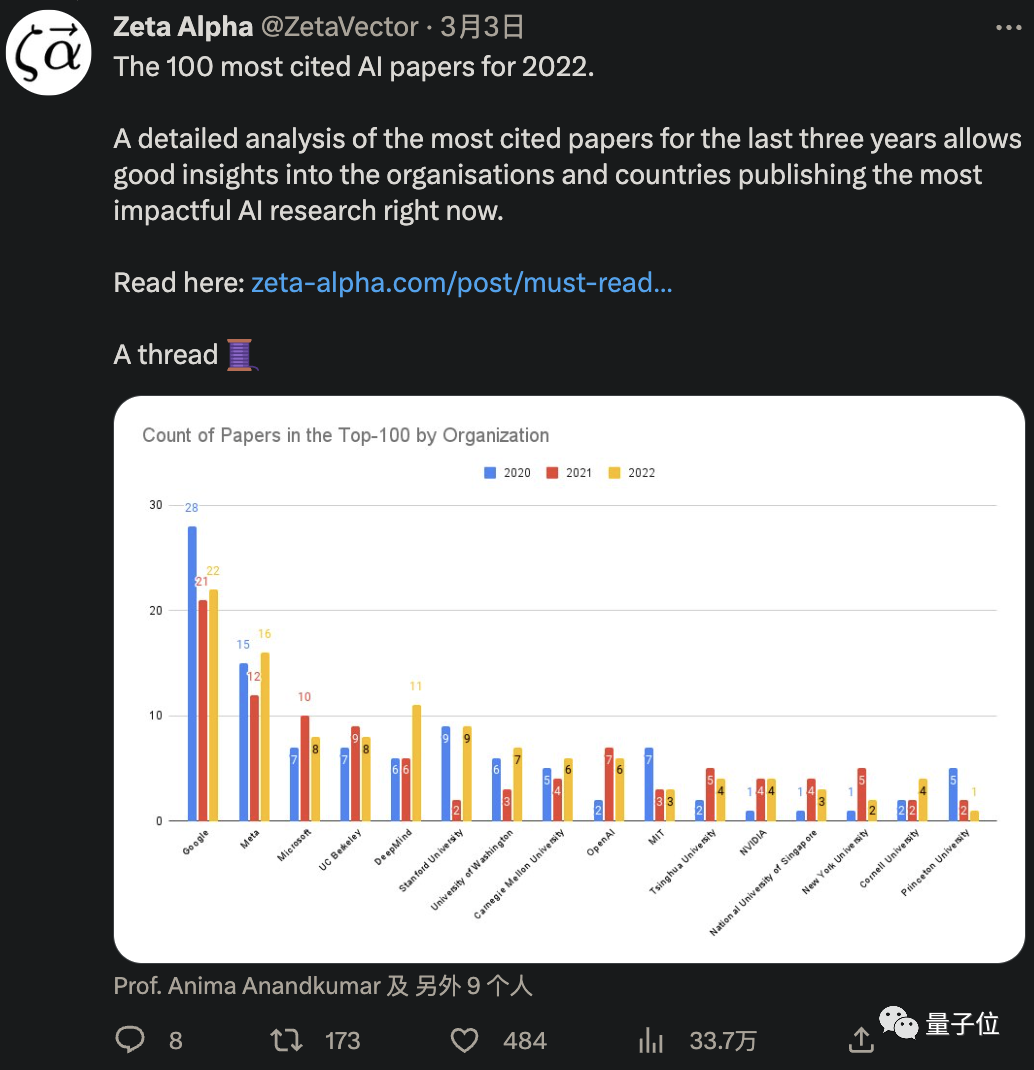

DPU 中游环节(DPU 芯片厂商):海外巨头暂时领先,国产厂商蓄势待发。根据头豹研究院数据,2020 年国内 DPU 市场中,国际三大巨头英伟达,博通,Intel 份额分别达到 55%、36%、9%。国内厂商中,华为,阿里,百度,腾讯也在近几年针对自身服务器进行自研与外购 DPU,针对的主要功能在于数据,存储与安全方面。

DPU 上游环节:EDA、IP 等均为研发重要基础。国内 EDA 市场长期由国际三大巨头占据,未来有望迎来突破。供需合力孕育 IP 核产业,未来需求打开新增通道。半导体国产化持续演进,国内 IP 供应商将占据稀缺性价值高地,包括寒武纪、芯原股份等。

DPU 下游应用:多点开花,未来前景广阔。DPU 核心市场围绕数据中心展开,以服务器为硬件载体,下游场景覆盖云计算,高性能计算,网络安全,边缘计算等多个领域。从我国范围看,高新技术、数字化转型及终端消费等多样化算力需求场景不断涌现,算力赋能效应凸显。

ChatGPT 等 AI 技术发展大趋势下,算力需求凸显,DPU 有望迎来黄金发展期,全球、国内 DPU 产业市场规模呈现逐年增长的趋势,核心企业有望受益于行业发展趋势。

DPU 有望成为“第三颗主力芯片”

DPU(数据处理芯片 Data Process Unit)被认为是继 CPU 和 GPU 之后的“第三颗主力芯片”。DPU(Data Processing Unit)是新近发展起来的一种专用处理器。2020 年 NVIDIA 公司发布的 DPU 产品战略中将其定位为数据中心继CPU 和 GPU 之后的“第三颗主力芯片”。随着芯片业制造工艺的不断精进,以及数字化技术如 AI 的发展,芯片行业不断推陈出新。DPU 作为新型芯片的一种,它的出现是异构计算的一个阶段性标志。

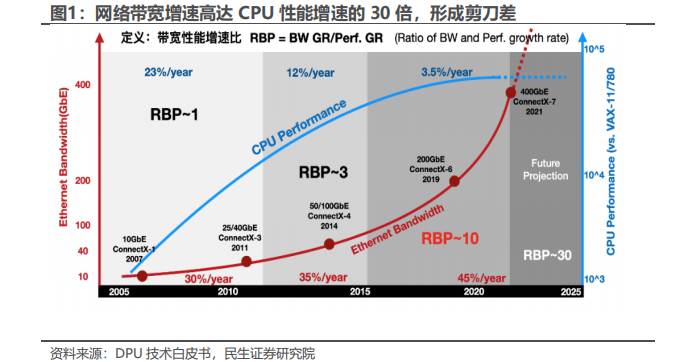

1、算力提升与数据增幅呈现剪刀差,DPU 需求凸显

DPU 是以数据处理为核心的专用数据处理单元,是对传统计算资源的网络、安全和存储的卸载平台。传统数据中心以 CPU 为主要数据处理单元,通常庞大的基础架构的运行已占据相当一部分 CPU 核,给数据处理任务带来非常大的挑战。

DPU 其实在行业内已经孕育已久,从早期的网络协议处理卸载,到后续的网络、存储、虚拟化卸载。

根据摩天轮数据,Amazon 的 AWS 早在 2013 年研发了 Nitro 产品,将数据中心开销(为虚机提供远程资源、加密解密、故障跟踪、安全策略等服务程序)全部放到专用加速器上执行。Nitro 架构采用轻量化 Hypervisor 配合定制化的硬件,将虚拟机的计算(主要是 CPU 和内存)和 I/O(主要是网络和存储)子系统分离开来,通过 PCIe 总线连接,节省了 30%的 CPU 资源。

2016-2017 年,阿里云就提出 X-Dragon 系统架构,其核心是 MOC 卡,且有比较丰富的对外接口,也包括了计算资源、存储资源和网络资源。MOC 卡的核心 X-Dragon SOC,统一支持网络,I/O、存储和外设的虚拟化,为虚拟机、裸金属、容器云提供统一的资源池。

根据网易、芯东西数据,2019 年,美国一家初创公司 Fungible 推出产品 F1DPU,第一次提出了 DPU 的概念。2020 年 10 月,英伟达将基于 Mellanox 方案的 Smart NIC 命名为 DPU,重新定义了 DPU 的概念。2020 年,英伟达公司发布的 DPU 产品战略中将其定位为继 CPU 和 GPU 之后数据中心的“第三颗主力芯片”,掀起了行业热潮。

2、以降本增效为目标,DPU 直击行业痛点

DPU 要解决的核心问题是基础设施的“降本增效”,即将“CPU 处理效率低下、GPU 处理不了”的负载卸载到专用 DPU,提升整个计算系统的效率,降低整体系统的总体拥有成本(TCO)。

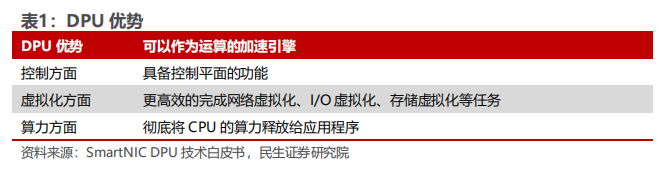

CPU 资源负载过大为行业痛点,智能网卡(Smart NIC)为 DPU 前身。在通信领域,伴随着 5G、云网融合时代的到来,以及虚拟交换等技术的引入,基于服务器的网络数据平面的复杂性急剧增加。海量的数据搬运工作被 CPU 承担,导致网络接口带宽急剧增加,CPU 资源负载过大,大大影响了 CPU 将计算能力释放到应用程序中,为了提高主机 CPU 的处理性能,Smart NIC(智能网卡)将部分CPU 的网络功能(如 IP 分片、TCP 分段等)转移到网卡硬件中,起到了加速运算的目的,其可视为 DPU 的前身。新一代的 DPU 的优势在于不仅可以作为运算的加速引擎,还具备控制平面的功能,可以更高效的完成网络虚拟化、I/O 虚拟化、存储虚拟化等任务,并彻底将 CPU 的算力释放给应用程序。

功能方面,DPU 具备集成基础业务、网络数据加速、零信任保护、算存分离等多种功能。可有效解决当前 CPU 算力无法完全作用到应用程序,数据处理速度慢,授信导致的数据泄露,存储方案兼容性差等诸多问题。具体来说:

1.DPU 实现了业务与基础设施的操作分离。DPU 将基础设施任务从 CPU 转移至 DPU,释放 CPU 的资源,使更多的服务器 CPU 核可用于运行应用程序,完成业务计算,从而提高服务器和数据中心的效率。

2.DPU 卸载网络数据,实现性能提升。DPU 针对云原生环境进行了优化,提供数据中心级的软件定义和硬件加速的网络、存储、安全和管理等服务。根据程序员客栈数据,红帽 Red Hat 的容器化云平台即服务(PaaS)0penShift 上,借助 DPU优化数据中心资源利用率,将网络相关的数据处理(如 VxLan 和 IPSec 等)卸载到 DPU 加速执行,在 25Gb/s 网络条件下,Open Shift 部署 DPU 用来加速,可以只用 1/3 的 CPU 占用率来达到 25Gb/s 性能,而在 100Gb/s 网络条件下,未部署 DPU 的场景将达不到 100Gb/s 网络线速,DPU 可以带来 10 倍的性能优势。

3.DPU 可以提供零信任安全保护,零信任(Zero Trust)是一种以安全性为中心的模型,其基于以下思想︰企业不应对其内外的任何事物授予默认信任选项。零信任可以减少数据泄露、拒绝未授权的访问,因此在数据安全方面价值很大。

方式:DPU 通过将控制平面由主机下放到了 DPU,来为企业提供零信任保护,实现主机业务和控制平面的完全隔离,数据将无法进行穿透,保证安全性。

DPU 的出现相当于为每个服务器配备了一台“计算机前的计算机”,以提供独立、安全的基础设施服务,并与服务器应用域安全隔离。如果主机遭受入侵,安全控制代理与被入侵主机之间的 DPU 隔离层可防止攻击扩散至整个数据中心。这样 DPU就解决了企业不愿直接在计算平台上部署安全代理的情况。通过在完全隔离于应用程序域的DPU 上部署安全代理,企业不仅能获得对应用程序工作负载的可见性,还能在其基础设施中执行一致的安全策略。

4.DPU 助力实现“算存分离”,BlueField SNAP 技术方案通过在服务器系统的数据入口处引入计算资源,在 DPU 上独立实现面对应用需求的存储方案,帮助存储厂商在数据中心中低成本地灵活部署、升级高级存储协议,而完全不需要对现有软件栈进行任何更改。存储厂商可以把自家团队为各行业应用开发的开放系统的直连式存储(DAS)、纵向扩展(Scale-up)、横向扩展(Scale-out)、超融合架构(Hyperconverged)等存储解决方案,零开销地推广到各个应用领域的现有业务处理平台和数据中心基础架构中,而所有的安全加密、数据压缩、负载均衡等复杂又必须的功能则完全由 DPU 透明地卸载。存储行业的革新算法和实现,可以在 DPU架构中,独立于服务器操作系统进行部署。DPU 技术帮助存储厂商实现真正的“算存分离”,完全发挥自家产品的技术优势,打通最高效服务应用需求的通路。

3、依托智能网卡化茧成蝶,FPGA 及混合架构路线为主流

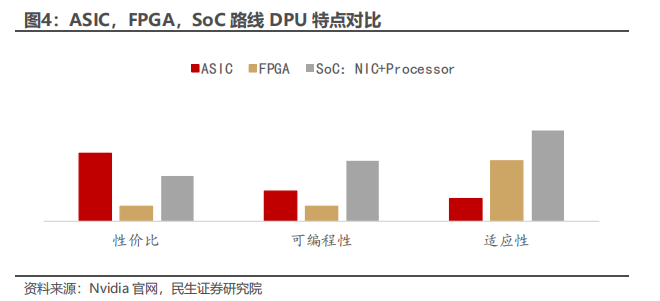

Smart NIC 可以被看作 DPU 的前身,包含基于多个 CPU 内核的 ASIC 和基于 FPGA 的智能网卡等类型。随着技术的发展,FPGA、ASIC 和 SoC 也在相互融合,它们之间的界限越来越模糊。例如,随着 FPGA 的发展,现在很多 FPGA 内部集成了硬核,这种硬核就是传统意义上的 ASIC;从硬件可编程的角度来看,SoC 与 FPGA 相反,它可以看作 ASIC,这里的 ASIC 主要指硬件不可编程,而不是单指特定功能芯片。

NIC 代表网络接口卡。实际上,NIC 是一种插入服务器或存储盒以连接到以太网网络的 PCIe 卡。基于 DPU 的 Smart NIC 超越了简单的连接,在基础 NIC 的情况下,在 NIC 上实现了 CPU 必须执行的网络流量处理。

基于 DPU 的 Smart NIC 可以是基于 ASIC、FPGA 和 SoC 的。在这些不同的路线之间,在成本、编程的易用性和灵活性方面存在各种权衡。1)ASIC 具有成本效益,可能提供最佳性价比,但灵活性有限。基于 ASIC 的 NIC,如 NVIDIA ConnectX-5,可以具有相对简单的可编程数据路径。最终,该功能基于 ASIC 中定义的功能而受到限制,这可能会阻止支持某些工作负载。2)相比之下,FPGA NIC(如 NVIDIA Innova-2 Flex)具有高度可编程性。只要有足够的时间和精力,就可以在可用门的约束范围内相对高效地支持几乎任何功能。然而,众所周知,FPGA 编程困难且价格昂贵。3)对于更复杂的用例,SOC(如 Mellanox BlueField DPU–可编程智能网卡)提供了似乎是最好的基于 DPU 的 Smart NIC 实现。

4、DPU核心价值在于算力的卸载释放与扩展,异构算力互联推动 DPU 多领域高速发展

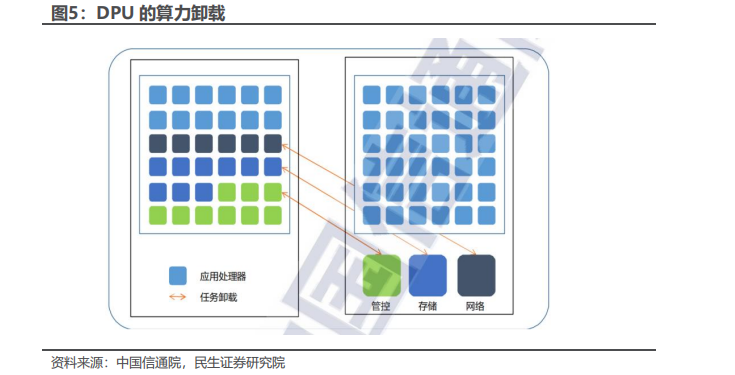

1.算力卸载:即利用 DPU 集成一部分数据处理的基本功能,然后将这些功能从 CPU 中卸载下来,以提升 CPU 针对部分应用的算力。DPU 的部分价值体现在节省这部分算力的成本-DPU 自身的成本。因此 DPU 节省的算力越多,或 DPU 的成本越低,其带来的价值越高。与此同时,由于 DPU 的专用化,DPU 将部分涉及网络、存储、安全、管理相关的控制功能卸载之后,还将使得业务性能得以提升,因此 DPU 的另一部分价值在于其可为业务节省的时间与使用体验。

根据技术邻数据,在大型数据中心的场景之中,DPU 的算力卸载功能可用于减少数据中心税。由于在数据中心流量处理占了计算 30%的资源,AWS 将这些还未运行业务程序,先接入网络数据就要占去的计算资源称为“数据中心税(Data center Tax)”。

在数据安全场景中,DPU 由于其独立、安全的架构,可将部分加密、解密算法固化在 DPU硬件之中,以物理隔离的方式解决用户在海量数据的数据安全问题,为外部网络业务租户之间提供额外的安全层。

2. 根据中国信通院数据,算力释放:算力释放无需 CPU 介入多次访问内存和外设,避免不必要的数据搬运,拷贝和上下文的切换,直接在网卡硬件上对数据完成处理并交付给最终消费数据的应用。传统以 CPU 为中心的计算机体系结构在处理数据的过程中需要多次在内核和应用之间拷贝和访问数据,带来的是极大的性能损耗。以数据为中心的 DPU 架构则可以有效改善 CPU 过度参与数据处理的问题,在数据处理的过程中不需要 CPU 参与,直接将数据送达应用、相关的 GPU或者存储设备,能够有效避免性能瓶颈和由于 CPU 负载过大而引发的异常。

DPU 架构和技术,使服务器上运行的业务应用和操作系统内核,用简单的本地存储访问 API,就能实现对分布式、超融合或软件定义存储系统的高效透明访问。存储厂商可以把为各行业应用开发的直连式存储(DAS)、纵向扩展(Scale-up)、横向扩展(Scale-out)、超融合架构(Hyperconverged)等存储解决方案,零开销地推广到各个应用领域的现有业务处理平台和数据中心基础架构中,而所有的安全加密、数据压缩、负载均衡等复杂又必须的功能则完全由 DPU 透明地卸载。存储行业的革新算法和实现,可以在 DPU 架构中,独立于服务器操作系统进行部署。

DPU 技术帮助存储厂商实现真正的“算存分离”,完全发挥自家产品的技术优势,打通最高效服务应用需求的通路。

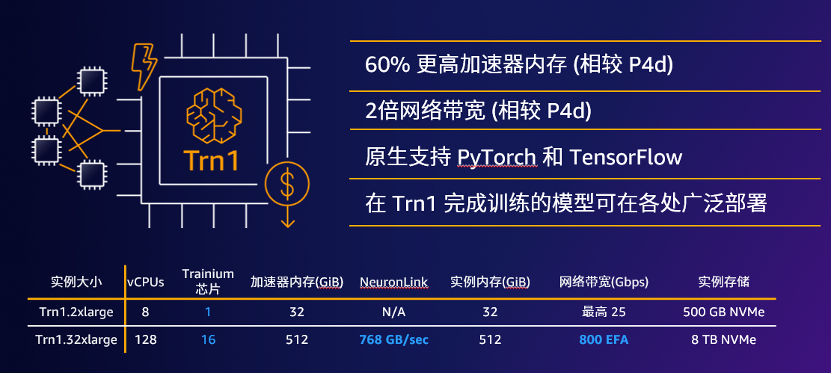

3.算力扩展:算力扩展即通过有效避免拥塞消除跨节点的网络通信瓶颈,显著降低分布式应用任务周期中的通信耗时占比,在大规模的集群维度提升计算集群的整体算力。为了提升算力,业界在多条路径上持续演进。通用 CPU 已很难继续通过提升单核单线程的性能和扩展片内多核的方式来大幅提升算力。单核芯片的工艺提升至 3nm 后,发展放缓;通过叠加多核提升算力,随着核数的增加,单位算力功耗也会显著增长,当 128 核增至 256 核时,总算力水平无法线性提升。在计算单元的工艺演进已经逼近基线,为了满足大算力的需求,通过分布式系统,扩大计算集群规模,提升网络带宽,降低网络延迟成为提升数据中心集群算力的主要手段。

5、DPU 带动异构算力互联,应用市场涵盖高新技术产业多领域

异构算力互联即为 GPU、FPGA、ASIC 或其它加速卡与 CPU 之间的数据连接。在 CPU 与加速卡之间,以及加速卡之间形成的芯片互联技术被更多的采用,虽然 PCIe 有着非常通用的标准化设计,但带宽有限将会产生瓶颈。以 CXL 和 Gen-Z 为代表的等下一代互联技术取得快速发展,DPU 作为各种高速互联协议融合的沙盒,最适合成为灵活的高速互联载体,通过采用和扩展“以内存为中心”的互联协议,将带来在单个机箱外部扩展亚微秒级延迟技术的机会,为下一代计算架构创新创造可能性。

伴随信息化建设与应用的而深入,市场持续高涨,DPU 产业在电信、互联网、智能驾驶、AI 服务器及其他行业应用需求不断增长。

1)在电信领域,三大运营商均积极布局,推动产品验证,并提出与产业链上的厂商推动 DPU 产业发展的合作意愿。

2)在互联网领域,随着云计算、云原生等业务场景的发展需求,DPU 作为数据中心演进的焦点,受到各大云厂商的广泛关注。头部厂商纷纷投入资源尝试自研或者战略合作,降本增效,实现效益的最大化。

3)在智能驾驶领域,国内外芯片厂商加速布局智能驾驶,不断提升研发效率,为 DPU 的市场发展奠定基础。

4)针对 AI 服务器及其他领域层面,在数字经济和“东数西算”等政策影响下,中国 AI服务器、金融、终端政企及其他领域持续高速发展,对算力的需求不断增加,传统的技术已无法满足当前业务的发展需求,DPU 能够提供成熟的硬件加速方案,提升整个系统的效率,为 AI 服务器、金融及其他领域的发展提供技术支撑,全面推进DPU 产业未来的发展进程。