你的ChatGPT数据可以不被官方拿去训练模型了!代价是「只聊天不记录」

本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

ChatGPT出新规了。

似乎是为了应对数据隐私方面的争议,OpenAI最新blog宣布了ChatGPT数据使用的新规则:

用户可以通过关闭聊天记录功能,来避免自己的个人数据被官方拿去训练。

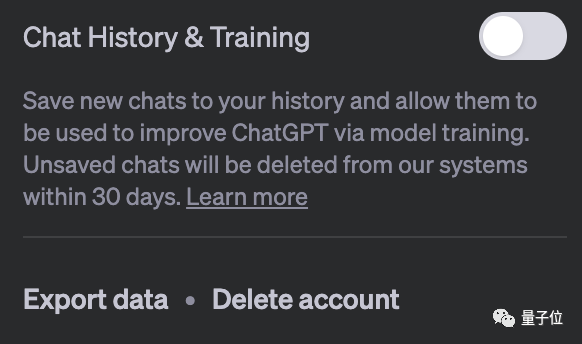

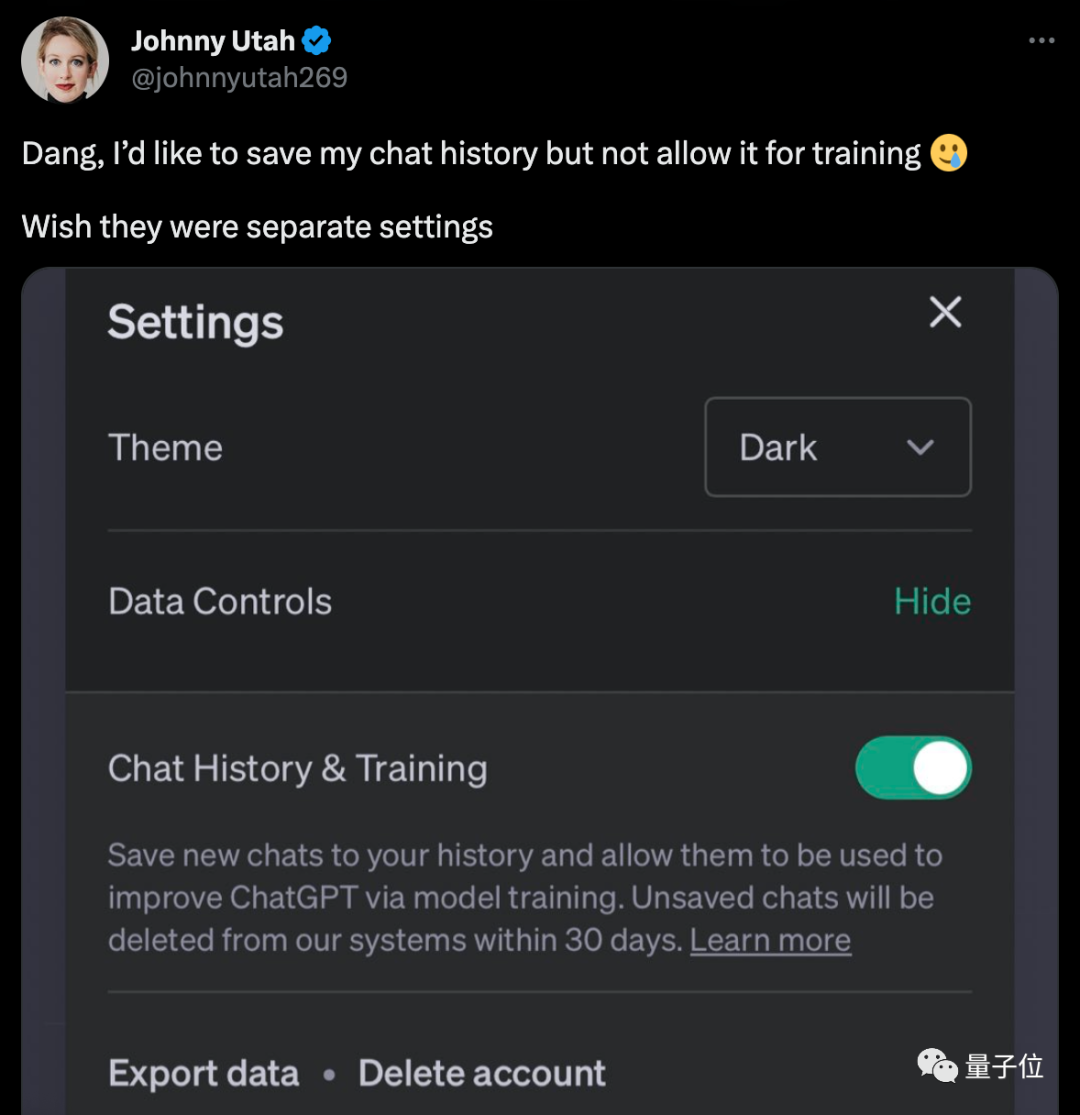

现在在用户个人管理中,已经出现了一个关闭“Chat history&training”的选项。

只要点击取消,历史记录就被禁用了,新的对话也不会再存入聊天记录里。

但新的对话还是会在官方系统里留存30天,OpenAI解释说:

只有在监控是否存在数据滥用时才会审查这些数据,30天后将永久删除。

同时还上线了一个导出聊天记录的Export功能,方便用户自己保存数据。

同样是出于数据保护方面的考虑,OpenAI还表示将推出ChatGPT企业版(ChatGPT Business)。

这种版本面向的是对数据保护有更高要求的用户们,相关规则会和API用户的一致,也就是数据完全不会被拿去训练。

官方表示,预计这一版本将会在未来几个月内上线。

网友:这不极限二选一?

如上提到的用户数据被拿去训练,是ChatGPT对话能力提升的途径之一。

数据越多意味着模型能被训练地越精准、聪明。

但它同样牵扯到了用户的隐私安全保护问题。OpenAI声明他们不会滥用收集到的数据,可还是在全球范围内引发了不小的担忧。

由此这次用户数据安全新规推出,不少人都点赞了。

表示这确实能在更大程度上保护个人隐私,同时又不会免费为新模型训练提供数据。

还有一部分人想着“既要又要”:

为什么不能既保留聊天记录,又不拿数据训练?

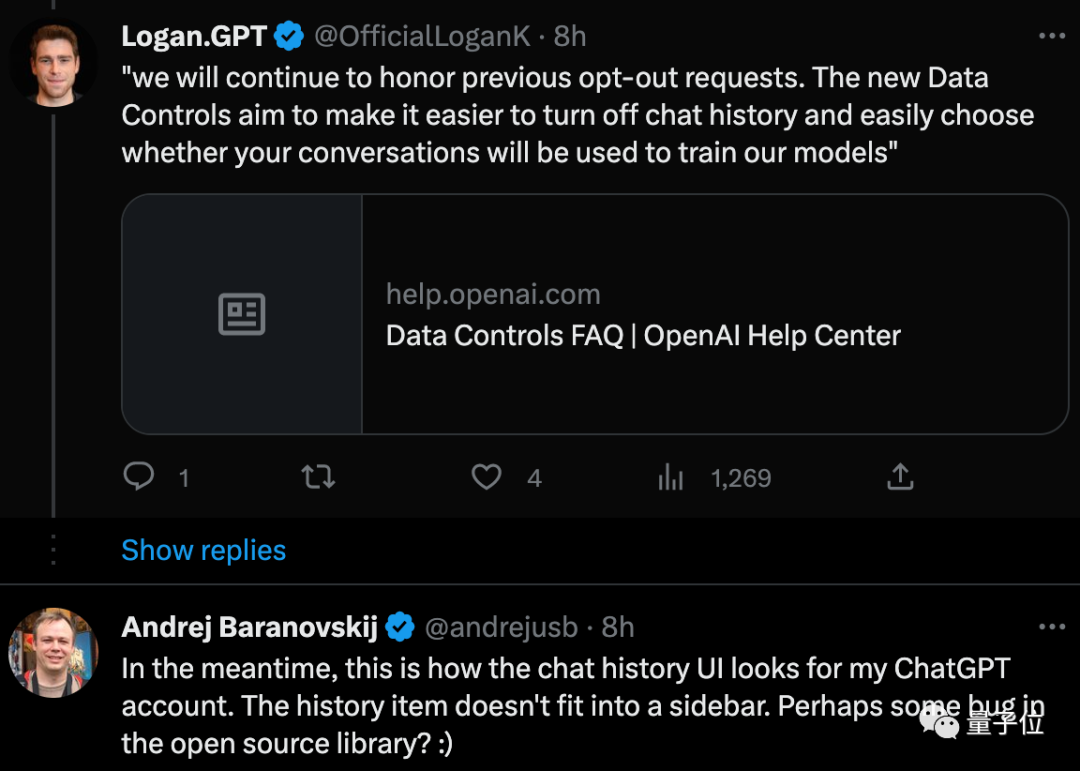

也有人表示,自己之前就填写了表单,表示不愿意被ChatGPT使用数据,那么现在这部分人会受到什么影响吗?

官方表示他们还会尊重之前申请用户的意愿,新的方法只是将关于训练数据这个过程变得更简单了些。

此前OpenAI开放了一个表单,供不愿意个人数据被拿去训练的用户填写申请。

与此同时他们也提醒用户,如果自己使用了一些插件/软件恶意抓取用户数据,新功能是干预不了的。

有人就发现当自己关闭数据训练后,一些插件也消失了。这可能就是OpenAI为了避免数据在其他地方泄露采取的应对策略。

值得一提的是,这不是OpenAI第一次调整ChatGPT隐私数据使用规则了。

3月1日开始,所有调用API接口的用户数据,将不再被用于模型训练,除非用户自愿提供。

在此之前,如果用户没有特殊要求,默认数据也是会被拿去训练的。

调整后,API接口用户发出的数据同样会被放在系统内保存30天,应对一些监测审查。

调用API后的数据传输是加密的,但数据都会在美国保存和处理。

欧洲成立ChatGPT特别工作组

OpenAI之所以在几个月内频繁地发布数据隐私方面的公告,主要原因或许还是ChatGPT的数据使用已经引发了不小恐慌。

最先“发难”的是意大利,他们以违反欧洲数据隐私法GDPR为由,暂时禁止了ChatGPT。该国监管机构命令OpenAI停止从意大利客户收集数据,并披露纠正该国独立机构提出投诉的步骤。

之后德国、法国、西班牙等也传出了或将加入这一阵营的消息。

4月13日,欧洲各国监管机构表示已就ChatGPT成立了一个特别工作小组。这意味着制定人工智能隐私规范共同政策,或将迈出重要一步。

这种隐私数据方面的担忧,不仅来自于OpenAI的数据收集使用方式,还有一部分原因是用户导致的。

随着越来越多人将ChatGPT加入工作流,上传的数据中难免会夹带公司机密。

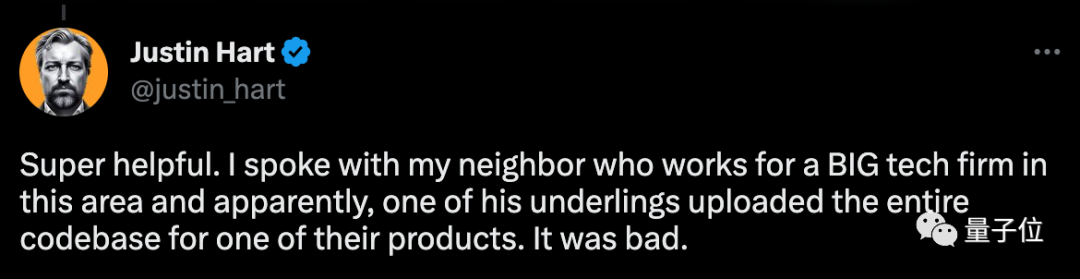

有人就表示自己听说有科技巨头员工把产品代码全上传了。

所以,及时给员工制定ChatGPT使用规范,成为当下不少企业都在考虑的事。

比如三星就被传出过因ChatGPT数据泄露的消息,软银、台积电等企业目前也对员工使用ChatGPT提出了要求。

总之,在ChatGPT改变工作方式、改变世界的同时,制定出合理的数据隐私规范,也迫在眉睫了。